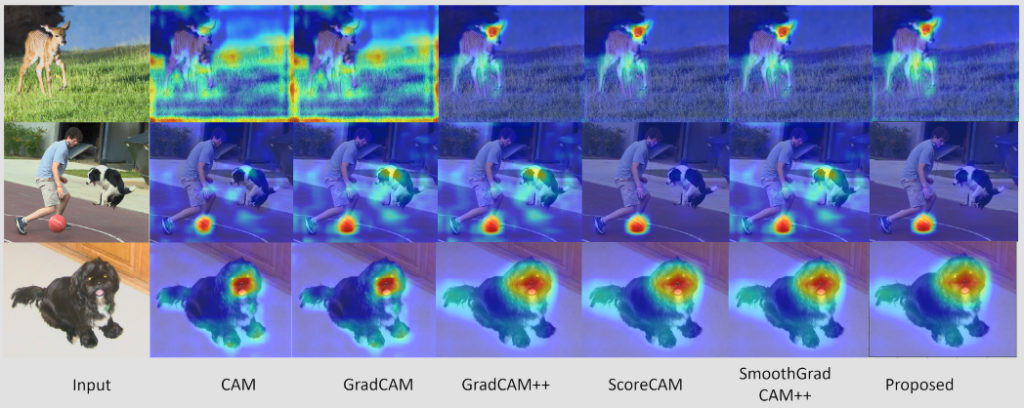

Gradient-weighted Class Activation Mapping (Grad-CAM)이란 설명 가능한 인공지능 (eXplainable Artifical Intelligence, XAI) 기술중 하나로, 딥러닝 내부 동작 원리를 시각화 하는 방법.

- Class Activation Map (CAM): 딥러닝 모델에서 특정 클래스와 관련된 입력 이미지 영역을 시각화.

GAP을 통해 각 채널의 정보를 하나의 값으로 요약함.

FC Layer를 통해 어떤채널이 중요했는지 판단함. - Grad-CAM:

GAP 구조가 없이 미분을 통해 어떤채널이 결정적이었는지 역으로 계산함.

CAM vs Grad-CAM 장단점 비교

| 구분 | CAM (Class Activation Map) | Grad-CAM (Gradient-weighted CAM) |

| 구조 제약 | 매우 높음. (반드시 GAP 구조여야 함) | 없음. (모든 CNN 기반 모델 가능) |

| 재학습 여부 | 구조 변경 시 재학습 필요 | 재학습 없이 기존 모델 그대로 사용 가능 |

| 정교함 | 히트맵이 비교적 단순하고 큼직함 | CAM보다 더 세밀한 시각화가 가능함 |

| 장점 | 구조가 단순할 때 이론적으로 명확함 | 범용성이 압도적임 (YOLO, GAN 등에도 가능) |

| 단점 | 모델 구조를 마음대로 바꿀 수 없음 | 미분 값을 계산해야 하므로 연산이 한 단계 더 필요 |

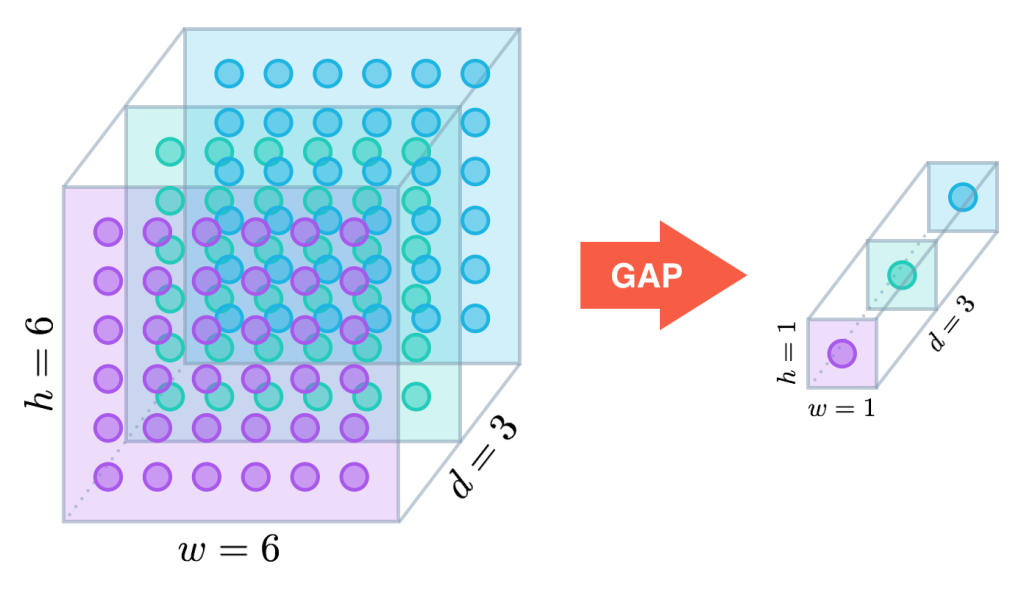

Global Average Pooling(GAP, 전역 평균 풀링)

하나의 Feature Map(채널) 전체를 평균내어 하나의 숫자로 만드는 기술.각 픽셀에 대한 정보를 1차원으로 펴고 이를 출력으로 사용.

FC Layer (완전 연결 계층)

CAM에서 FC는 1차원 정보 (예: 512개의 특징을 얼마나 강하게 나타내는지 숫자로 나타낸다면. 512길이의 1차원배열)를 가지고 그래서 이게 뭔데?

고양이인가 강아지인가 판단하는 분류기(Classifier) 역할을 함.